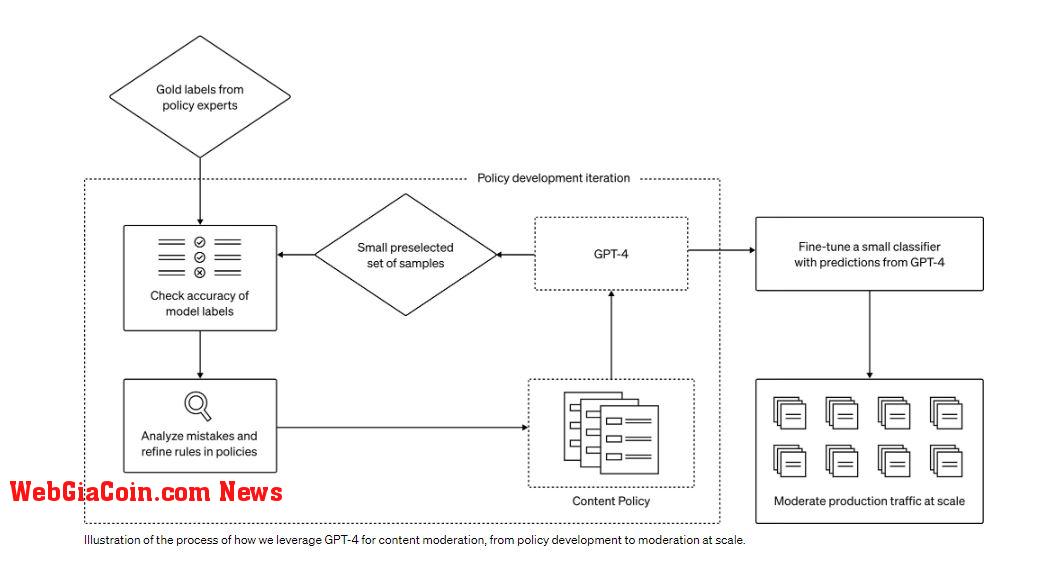

Thông tin chi tiết thu được từ những nỗ lực này sẽ góp phần hoàn thiện chính sách nội dung hiện tại hoặc xây dựng chính sách mới trong các lĩnh vực rủi ro chưa được khám phá.

OpenAI, nhà phát triển đằng sau ChatGPT, đang ủng hộ việc sử dụng trí tuệ nhân tạo (AI) trong kiểm duyệt nội dung, khẳng định tiềm năng của nó trong việc nâng cao hiệu quả hoạt động cho các nền tảng truyền thông xã hội bằng cách đẩy nhanh quá trình xử lý các nhiệm vụ đầy thách thức.

Công ty AI, được hỗ trợ bởi Microsoft, cho biết mẫu GPT-4 AI mới nhất của họ có khả năng rút ngắn đáng kể thời gian kiểm duyệt nội dung từ vài tháng xuống còn vài giờ, đảm bảo cải thiện tính nhất quán trong việc ghi nhãn.

Việc kiểm duyệt nội dung đặt ra một nỗ lực đầy thách thức đối với các công ty truyền thông xã hội như Meta, công ty mẹ của Facebook, đòi hỏi sự phối hợp của nhiều người kiểm duyệt trên toàn cầu để ngăn người dùng truy cập tài liệu có hại như nội dung khiêu dâm trẻ em và hình ảnh bạo lực cao.

"Quá trình (kiểm duyệt nội dung) vốn đã chậm và có thể dẫn đến căng thẳng tinh thần cho người kiểm duyệt. Với hệ thống này, quá trình phát triển và tùy chỉnh chính sách nội dung được rút ngắn từ hàng tháng xuống hàng giờ."

Theo tuyên bố, OpenAI đang tích cực điều tra việc sử dụng các mô hình ngôn ngữ lớn (LLM) để giải quyết các vấn đề này. Các mô hình ngôn ngữ mở rộng của nó, chẳng hạn như GPT-4, có khả năng hiểu và tạo ra ngôn ngữ tự nhiên, khiến chúng phù hợp để kiểm duyệt nội dung. Các mô hình này có khả năng đưa ra các quyết định kiểm duyệt được hướng dẫn bởi các nguyên tắc chính sách được cung cấp cho chúng.

Dự đoán của GPT-4 có thể tinh chỉnh các mô hình nhỏ hơn để xử lý dữ liệu mở rộng. Khái niệm này cải thiện việc kiểm duyệt nội dung theo một số cách bao gồm tính nhất quán trong nhãn, vòng phản hồi nhanh và giảm bớt gánh nặng tinh thần.

Tuyên bố nhấn mạnh rằng OpenAI hiện đang nỗ lực nâng cao độ chính xác dự đoán của GPT-4. Một con đường đang được khám phá là sự tích hợp của lý luận chuỗi suy nghĩ hoặc tự phê bình. Ngoài ra, nó đang thử nghiệm các phương pháp để xác định những rủi ro không quen thuộc, lấy cảm hứng từ AI trong Hiến pháp.

Mục tiêu của OpenAI là sử dụng các mô hình để phát hiện nội dung có khả năng gây hại dựa trên các mô tả rộng về tác hại. Thông tin chi tiết thu được từ những nỗ lực này sẽ góp phần tinh chỉnh các chính sách nội dung hiện tại hoặc tạo ra các chính sách mới trong các lĩnh vực rủi ro chưa được khám phá.

Hơn nữa, vào ngày 15 tháng 8, Giám đốc điều hành của OpenAI, Sam Altman, đã làm rõ rằng công ty không đào tạo các mô hình AI của mình bằng cách sử dụng dữ liệu do người dùng tạo ra.

Tạp chí: AI Eye: Apple phát triển AI bỏ túi, thỏa thuận âm nhạc giả sâu, thôi miên GPT-4

Theo CoinTelegraph

|

|

Tags: Công nghệ, Trò chuyệnGPT,

Bạn đang ở:

Bạn đang ở: